von Gwen Schlüter

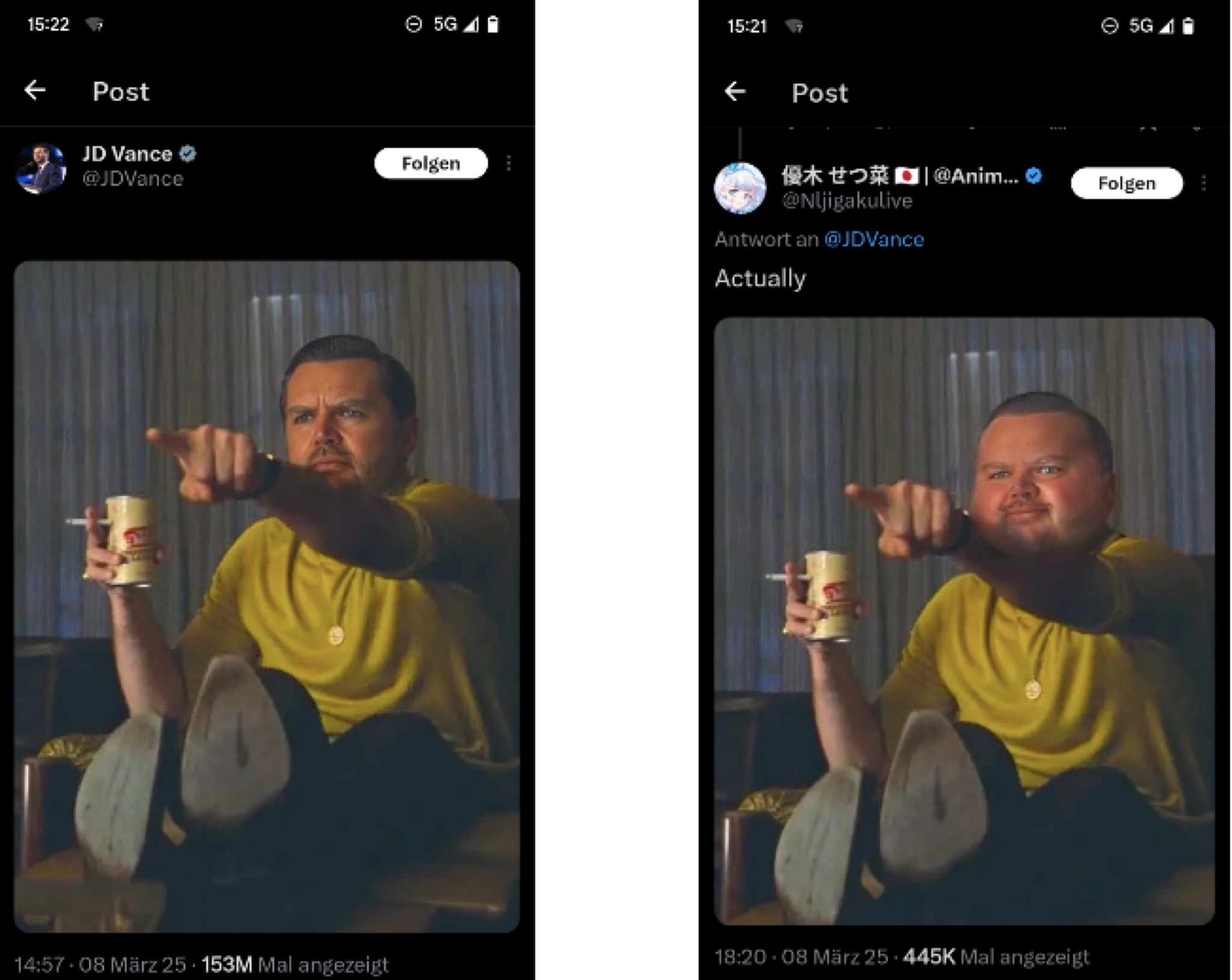

Am 8. März 2025 postete JD Vance auf seinem X-Account ein Bild, in dem das Pointing Rick Dalton-Meme aufgegriffen wurde. Der Kopf von Leonardo DiCaprio, der in einer bekannten Szene des Films Once Upon a Time in Hollywood auf einen Fernseher deutet, um zu zeigen, dass er darin zu sehen ist, wurde hier durch den des US-Vizepräsidenten ersetzt. Wenig später folgte ein Antwort-Tweet von @AnimeNYC mit einer Version, in der das Gesicht erneut modifiziert wurde: die Abbildung zeigte unverkennbar JD Vance, allerdings waren seine Züge pausbäckig und aufgedunsen, zudem war der Kopf nur grob in das originale Foto hinein retuschiert. Die Caption zu dem Tweet lautete: „Actually“.

Der aufgedunsene Vance-Kopf machte den Kontext explizit, in dem der Vize-Präsident das Bild geteilt hatte. Nach dem Besuch des ukrainischen Präsidenten Volodomir Zelenskyj und dem berüchtigten Eklat im Weißen Haus waren immer mehr Vance-Memes aufgetaucht und begründeten einen Trend, der von unterschiedlichen Blasen des Netzes freudig aufgegriffen wurde. Vance’ Miene verlor zunehmend an Proportion, die Gesichtszüge wurden weicher gezeichnet, bis die Assoziation mit einem Kleinkind nicht mehr fern lag. Dazu bekam Vance immer neue Konstüme. Mal wurde er als Minion dargestellt, mal mit schwarzem Kajal porträtiert, wahlweise auch mit Hut und Lolli.

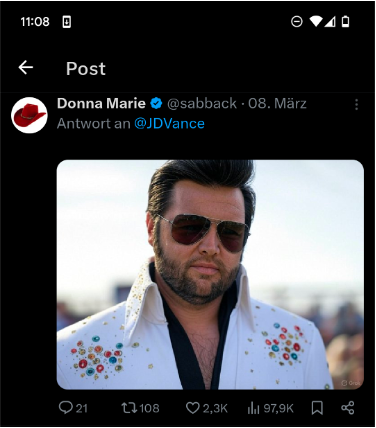

Beim DiCaprio-Post wiederum, mit dem der Vizepräsident in selbstreferentieller Geste auf diesen Meme-Trend reagierte, war in der Kommentarspalte ein interessantes Phänomen zu beobachten: Neben weiteren Versionen der Vance-Meme-Faces, posteten mehrere Accounts Bilder, die eindeutig KI-generiert waren. Diese zeigten den Vize-Präsidenten als Personifizierungen verschiedener Figuren aus der Popkultur. Mal wurde er als Elvis dargestellt, mal als Robin Hood, aber auch als eine Art Pin-Up-Boy in der Mode der 50er Jahre. Im Gegensatz zu den grotesk wirkenden Vance-Gesichtern in den Memes präsentierten sich diese Bilder in der typisch-glatten KI-Ästhetik: ‚Vance’ ist hier oft in seitlich einfallendes, warmes Licht getaucht, die Gesichtszüge geschärft, die Farben saturiert. Insgesamt wirken die Bilder hyperrealistisch. Geteilt wurden sie zumeist von Accounts mit US-Flaggen-Emojis im Namen oder mit Profilbildern, auf denen MAGA-Caps abgebildet waren. Die Fülle dieser KI-generierten Bilder deutet darauf hin, dass es sich hier um eine ganz eigene Kategorie online geteilter Artefakte handelt, die sich von den zeitgleich zirkulierenden Vance-Memes signifikant unterscheidet.

AI-Slop has entered the chat

Das Zirkulieren von KI-Videos und -Bildern ist inzwischen fester Bestandteil des Nutzer*innen-Alltags in den sozialen Medien. Mal bezeichnen Journalist*innen und Medienforscher*innen diese als Memes, immer häufiger jedoch als AI-Slop, ein Name, der schon 2022 bei 4chan auftauchte und sich in etwa mit ‚KI-Abfall‘ übersetzen lässt. Obwohl eine Differenzierung, was genau als AI-Slop gilt, schwierig zu sein scheint, wird dennoch immer deutlicher, dass die Zunahme von AI-Content auf den sozialen Plattformen eine Art Zäsur in der sozialen Interaktion und kulturellen Produktion ankündigt.

Klassische Memes – wie sie in diesem Text in Abgrenzung zu Slop genannt werden sollen – sind laut der Meme-Forscherin Limor Shifman vor allem durch die Plattform-Architekturen der sozialen Medien des Web 2.0 zu einem weit verbreiteten Kommunikationsmedium avanciert. In der Remix-Kultur unterliegen Memes einem andauernden Prozess der Aneignung und ‚Neuverpackung‘, wie Shifman es nennt.1 Dieser Prozess gestaltet sich bei AI-Slop grundsätzlich anders, was die Frage aufwirft, ob die KI-Bilder überhaupt wie Memes gelesen werden können, oder ob sie nicht eine ganz eigene Form zirkulierender Inhalte darstellen.

Schaut man sich die Kommentare unter dem Post von JD Vance an, eröffnet sich ein interessantes Spannungsfeld: Während die Meme-Faces zwar eher von Anti-MAGA-Accounts geteilt wurden, fanden sich durchaus auch Pro-Trump/Vance-Accounts, die verschiedene Variationen der Vance-Gesichter posteten. Demgegenüber wurden die KI-generierten Bilder bis auf sehr vereinzelte Ausnahmen (Trump und Vance, die Putins Hände küssen; Vance porträtiert als Adolf Hitler) von Accounts geteilt, die sonst Vance- und Trump-freundliche Inhalte verbreiteten. An den Kommentaren unter dem Vance-Post zeigt sich somit exemplarisch, was auch in anderen Räumen des Netzes zu beobachten ist, dass nämlich AI-Content zumindest momentan eine große Beliebtheit auf Seiten der Prosument*innen des reaktionären politischen Spektrums findet. Die Frage ist, warum KI-Inhalte tendenziell bei Unterstützer*innen rechter Bewegungen aktuell diesen Zuspruch erfahren und ob bzw. inwiefern sich diese von memetischen Inhalten und Praktiken unterscheidet.

Da das Phänomen von AI-Slop gerade erst Einzug in den Plattform-Alltag hält und die Meme-Kultur wiederum sehr weitläufige und disparate Ausprägungen hat, zielt dieser Text darauf ab, eine vorläufige Differenzierung der beiden Bildformen vorzunehmen. Es ist der Versuch, ein paar Denkanstöße zu liefern, um die aktuellen Entwicklungen besser fassen zu können. In den folgenden Abschnitten soll es deshalb darum gehen, die beiden Netz-Phänomene Memes und AI-Slop zunächst voneinander abzugrenzen, ihre unterschiedlichen Ästhetiken in den Blick zu nehmen und schlussendlich auch ihre politische Wirkung genauer zu untersuchen.

Ähnlich im Umlauf

Zunächst stellt sich die Frage, was AI-Slop überhaupt ist. Im Podcast KI Verstehen vom Deutschlandfunk definiert Carina Schroeder AI-Slop als „Inhalte, die billig und massenhaft und ohne Anstrengung mit Hilfe von KI […] produziert wurden und die stark emotionalisieren sollen.“2 Schroeder stellt zudem fest, dass es verschiedene Motivationen gibt, Slop zu produzieren und in Umlauf zu bringen. Mal ist der Slop Ergebnis eines spielerischen Ausprobierens von AI-Tools, mal werden die Bilder zu kommerziellen Zwecken geteilt. Schließlich wird AI-Slop aber auch zunehmend von politischen Akteur*innen eingesetzt. Hier lassen sich durchaus Parallelen zur Meme-Kultur ziehen. Auch Memes werden aus Gründen des kommerziellen Nutzens geteilt, häufiger jedoch als kreative Spielereien oder politische Stellungnahmen.

Um festzustellen, worin genau die Unterschiede von Memes und AI-Slop liegen, kann es in einem ersten Schritt helfen, zuerst die grundlegenden Gemeinsamkeiten herauszuarbeiten. Sowohl bei Memes als auch bei AI-Slop handelt es sich um eine Praxis der Bilderzeugung und anschließenden Zirkulation. Memes und oftmals auch AI-Slop zeichnen sich durch das Aufgreifen bestimmter Motive aus, die auf andere zirkulierende Inhalte referieren. Dabei kann sich beim Teilen von Memes wie auch bei der Verbreitung von Slop-Bildern unter den Nutzer*innen ein gewisses Zugehörigkeitsgefühl einstellen.3 Hinzu kommt der Umstand, dass sich die Ausbreitung von KI-generierten Bildern ähnlich wie die von Memes in kaskadenartigen Trendketten vollzieht und oft auch an ein politisches oder popkulturelles Ereignis in der Gegenwart geknüpft ist. Beispielsweise war der Ausgangspunkt für den Meme-Trend der Vance-Faces vor allem dessen zynische Frage an Zelenskyj: „Have you said thank you once?“4 Die glorifizierenden KI-Bilder in Vance’ Antwort-Feed stellen wiederum eine Reaktion auf diesen Meme-Trend dar. Wie bei klassischen Internet-Memes schon lange der Fall, kommt es auch immer häufiger vor, dass Slop-Bilder eigene Trendketten anstoßen. Oft handelt es sich dabei um Bilder mit einem hohen sogenannten engagement bait – also Inhalten, die vornehmlich zur Interaktion (Like, Share, Comment) anregen sollen. Diese Art von Slop wird aktuell hauptsächlich auf Facebook verbreitet und dient in erster Linie kommerziellen Zwecken.5 Auch im Abzielen auf Interaktion zeigt sich eine strukturelle Ähnlichkeit zu Memes. Obwohl AI-Slop wie im Falle der Facebook-Posts häufig durch wirtschaftliche Interessen motiviert verbreitet wird, gleichen sich beide Bildformen darin, dass das Interagieren mit ihnen vor allem affektbasiert ist und zum Partizipieren anregen kann, bzw. soll.

Doch obwohl Slop und Memes zunächst Netzartefakte sind, die sich in ihrer Zirkulation durchaus ähneln, weist insbesondere die Art ihrer Produktion entscheidende Unterschiede auf, weshalb es verkürzt wäre, AI-Slop und Memes gleichzusetzen, wie im Folgenden deutlich wird.

Die Unmittelbarkeit von Memes

Das Internet-Meme arbeitet mit ‚gefundenem‘ Material aus fiktionalen Medienerzeugnissen (Serien, Filmen, Comics, Stockfotografie) oder Screenshots realer Momente aus Politik, Alltags- oder Celebrity-Kultur (bei denen es sich natürlich auch zum großen Teil um Inszenierungen handelt). Mit Hilfe einer entsprechenden Beschriftung und/oder einer groben Photoshop-Montage ziehen Memes oft Vergleiche und werden so zu einem Kommentar des gegenwärtigen Moments, den aktuellen Nachrichten, dem Alltagsgeschehen. Oft wird dabei das originale Foto zur Grundlage für eine Vielzahl weiterer Variationen, die zum Teil auch vergangene Meme-Trends aufgreifen. Ein Beispiel dafür ist das inzwischen weithin bekannte Meme von Pepe the Frog. 2015 fand die Figur zunächst als eher spielerisches Meme mit dem Catchphrase „Feels good man“ im Netz Verbreitung, wurde jedoch schnell von rechten Gruppen, Trump-Supportern und Shitpostern auf 4chan politisch vereinnahmt. 2019 wurde sie dann im Zusammenhang mit den Jugendprotesten in Hong Kong wieder aufgegriffen und zu einer Symbolfigur dieser dissidenten Bewegung. Es vollzog sich also ein Bedeutungswandel von „Pepe as play to Pepe as hate to Pepe as protest“.6

Viele Meme-Templates existieren inzwischen seit Jahrzehnten und drehen Schleifen in andauernden Aneignungs- und Weiterverarbeitungsprozessen. Memes sind damit etablierte Artefakte einer vielstimmigen Internetkultur und Produkte kollaborativer Prozesse zwischen Nutzer*innen in Nischenforen und auf kommerziellen Plattformen. Klassische Memes zeichnen sich dadurch aus, dass sie visuell nur insofern überzeugen müssen, als dass sie einen (selbst-)ironischen Witz, ein Gefühl oder auch eine satirische Kritik transportieren. Sie haben sich dabei in der visuellen Verworfenheit eingerichtet, feiern das „poor image“7 und sind ein wichtiger Bestandteil von Internet Ugly, einer Ästhetik, die der Medienkritiker Nick Douglas als „core aesthetic of memetic internet content“8 beschreibt.

Dieser Kategorie können auch die Vance-Memes zugeordnet werden. Denn eine besondere Qualität von Internet-Memes liegt darin, dass sie zumindest den Anschein erwecken, sich selbst nicht allzu ernst zu nehmen. Mit dem Bild, das der Vize-Präsident von sich selbst postete, und dem darin enthaltenen selbstreferentiellen Fingerzeig auf das eigene mediale Abbild, versuchte sich Vance in genau dieser Kerndisziplin humoristischer Internetkultur: zu zeigen, dass man ‚in on the joke‘ ist, dass man die Kunst der Selbstironie beherrscht.

Ganz gelang Vance dies allerdings nicht, wie die Antwort von @AnimeNYC deutlich macht. Diese weist darauf hin, dass Vance’ behauptete Selbstironie durch die Montage seines ‚realen‘ Gesichts unterminiert wird. Die Memes, auf die sich Vance in seinem Post bezieht, zeigen actually ein anderes, weniger schmeichelhaftes Abbild. Allerdings geht es bei den Vance-Memes inzwischen gar nicht mehr primär um den anfänglich inszenierten ‚Gesichtsverlust‘ des Vize-Präsidenten. Dass mittlerweile auch Pro-Trump-Accounts das Vance-Face verbreiten, zeigt, dass dieses bereits Teil von Internetfolklore geworden ist – Humor also, auf den sich alle einigen können.

Internet Ugly ist vermutlich nicht zuletzt deshalb eine so beliebte Ästhetik, weil Memes dadurch offen ihre Gemachtheit kommunizieren und diese nicht verschleiern. Es geht dabei nicht um Perfektion, sondern um einen spielerischen Eingriff, der durch Aneignung und Weiterverarbeitung jederzeit umgedeutet werden kann und dementsprechend als flüchtiger Witz dem Moment verhaftet scheint. Wie Hardesty et al. schreiben, ist die Weitergabe von Memes dabei „part of a politics that does not imagine a future or a utopia but moves fitfully as a way of dealing with affective attachments“.9 Das (politische) Kollektiv wird eher darüber gebildet, dass ein gemeinsames Lachen im Moment stattfindet.

Homogene Flächen

Anders verhält es sich mit KI-generierten Bildern. Ob in der Kunst wie bei den unheimlichen cursed images10 eines Charlie Engman oder dem kitschigen bis verstörenden AI-Slop: Besonders die fotorealistischen KI-Inhalte, die laut einer Studie von AI Forensics inzwischen 80 Prozent des AI-Contents auf Plattformen ausmachen,11 scheinen in ihrer Produktion und Ästhetik immer sowohl auf die physische, reale Welt als auch auf einen anderen Ort zu verweisen. Eine Welt, wie sie sein könnte, wie sie war oder sein wird. Das wirkt sich auch auf die Art und Weise der Wahrnehmung von AI-Content aus. Ob Pferde, die von Sprungbrettern einen Salto in den Pool vollführen, oder im Ozean schwimmende Menschen, die mit Haien schmusen – bei vielen Bildern und Videos pendelt der Rezeptionsmodus zwischen einem noch naiven Disruptionsmoment („Ist das so wirklich passiert?!“) und einer sich anbahnenden Abgeklärtheit („Hier muss es sich wohl um KI handeln.“). Eine mögliche Erklärung für diese visuelle Spannung zwischen ‚echt‘ und ‚fake‘ sind die technischen Voraussetzungen ihrer Produktion. Die originalen Bilder, mit denen die Text-to-image-Programme gefüttert werden, materialisieren sich als Spuren, also Indizes, in den generierten Bildern. Die Kunsttheoretikerin Rosalind Krauss beschreibt Indizes als „Markierungen […] einer besonderen Ursache, und diese Ursache ist das Ding, auf das sie sich beziehen, der Gegenstand, den sie bezeichnen.“12 Auch wenn KI-Inhalte deutliche Qualitätsunterschiede aufweisen und sich manche der Bilder leichter als Täuschung identifizieren lassen, erzeugt die Ähnlichkeit mit dem Original in den Trainingsdaten ein Gefühl der Vertrautheit und des Wiedererkennens. Selbst wenn der Umstand bekannt ist, dass dieTrampolin hüpfenden Kaninchen nicht real, sondern KI-generiert sind, verweisen sie doch auf Bilder und Videos der ‚echten‘ Tiere, die dem Text-to-Image-Modell zum Training zugeführt wurden.

Über die Ebene der Bildwahrnehmung hinaus haben die technischen Voraussetzungen der Datenverarbeitung auch soziale Implikationen für den Einsatz von KI. In einem Artikel des Schweizer Onlinemagazins Geschichte der Gegenwart schreibt der Bildwissenschaftler Roland Meyer, dass bei vielen der KI-generierten Bildern klar sei, dass sie künstlich erzeugt wurden. Dennoch würde durch den Umstand, dass die Modelle mit einer statistischen Mustererkennung arbeiten, gerade von konservativen und rechten Akteur*innen das Argument bemüht, dass von ihnen eine als universell zu geltende Objektivität ausgehe.

Das ist allerdings insofern irreführend, als sich die KI-Bilder und auch ihre distinktive Ästhetik aus dem bereits vorsortierten Material ihrer Trainingsdaten generieren. Meyer schreibt dazu, dass große KI-Bildgeneratoren eine „kommerzialisierte Bildkultur“ widerspiegeln, „die von Shopping-Websites, Social-Media-Plattformen und Stockfotografie-Datenbanken beherrscht wird“.13 Die Erzeugnisse großer KI-Modelle wie Midjourney sind also Echos normierter Bilderwelten und präsentieren sich – von ein paar typischen Glitches abgesehen – ähnlich wie das Bild-Genre der Werbefotografie als homogene Bildoberflächen.

Und das ist nicht das Einzige, was den Produkten großer KI-Anbieter einen kulturell tendenziösen Anstrich gibt. Im Prozess des sogenannten Fine-Tunings werden auf Discord-Channels Rankings besonders beliebter KI-Bilder erstellt, wie Meyer mit Rekurs auf eine Studie von Christo Buschek und Jer Thorp ausführt. Diese werden wiederum dazu genutzt, die Bilderzeugung dem visuellen Geschmack potenzieller Kund*innen anzupassen – einer eher homogenen Gruppe, die als weiß, männlich, mittelständisch, aus dem globalen Norden stammend und tech-affin gelesen werden kann. Meyer bezeichnet die Bildgeneratoren deshalb auch als „Klischeeverstärker“ und „Nostalgiemaschinen“.14 Dass die Bilder Erzählungen rechter Bewegungen in die Hände spielen, wie man bspw. an den glorifizierenden Vance-Bildern sehen kann, ist den technischen Prozessen also bereits eingeschrieben.

Für eine politische Strömung, die den Vergangenheitsverweis schon im Namen trägt – „great again“ –, können die Vance-Abbilder dazu dienen, Erinnerungen an eine stark romantisierte US-Popkulturgeschichte wachzurufen oder ein idealisiertes Bild der ’50er Jahre zu zeichnen. Die Bilder werden dabei mit der Politik der aktuellen US-Regierung und dem Versprechen verbunden, eine Utopie der Vergangenheit (wieder) herzustellen.

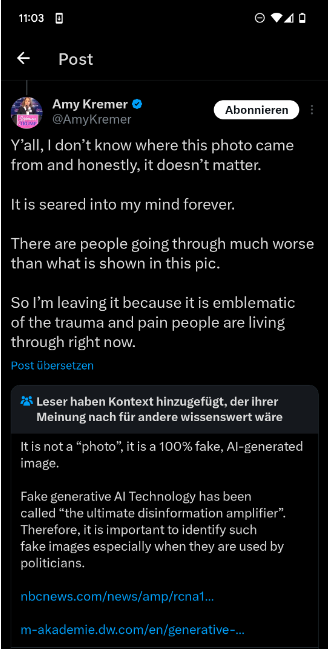

‚Slopaganda‘ nimmt dabei nicht nur die Form einer problematischen Heroisierung an, wie sie auch massenhaft auf den offiziellen Kanälen Donald Trumps und Elon Musks zu finden ist. Sie wird bspw. auch eingesetzt, um Ereignisse wie Naturkatastrophen für die eigene Politik zu instrumentalisieren. Die Mitbegründerin der Women for Trump, Amy Kremer, postete nach den Verwüstungen durch Hurricane Helene auf X das KI-generierte Bild eines in einem Boot sitzenden kleinen weinenden Mädchens mit einem Hund im Arm.15 Darauf aufmerksam gemacht, dass es sich dabei um ein KI-Bild handelte, twitterte sie: „Y’all, I don’t know where this photo came from and honestly, it doesn’t matter. It is seared into my mind forever. […] So I’m leaving it because it is emblematic of the trauma and pain people are living through right now.“

Gerade weil KI-generierte Bilder so häufig dazu eingesetzt werden, konservative bis rechtsextreme Propaganda zu verbreiten, stellt sich die Frage, ob bzw. wie AI-Slop auch auf progressive Weise genutzt werden kann.

Schlagabtausch in Bildern

Ein Grund, warum sich der Einsatz von KI-Modellen so gut für (rechte) politische Propaganda eignet, liegt wahrscheinlich darin, dass dadurch sehr buchstäbliche Bilder erzeugt werden. Katharina Stahlhofen schreibt in der taz, dass KI-Bilder „immer nur visuelle Renderings dessen [sind], was sprachlich formulier- und abrufbar ist. Sie sind oft billige Schlagworte, die sich als Bilder verkleiden.“16 Anders als bei Memes, bei denen es durch die verschiedenen Layer aus Montage und Text einfacher ist, Gegensätze und Reibung zu erzeugen, scheint es bei KI-generierten Bildern schwerer, eine abstrakte Humorebene einzuziehen. KI-Trends beruhen eher auf Prompt-Ideen (der Papst in Balenciaga) oder eingespeisten Fotos als, wie klassische Memes, auf Bildaneignung und Material-Remix. Das könnte auch eine Erklärung dafür sein, dass widerständige Interventionen mit KI vor allem auf eine visuelle Bloßstellung abzielen. Das Video, das im Zuge der DOGE-Entlassungen im Februar 2025 auftauchte und in dem Trump Musks Füße küsst, ist nicht weit entfernt von misogynen Deepfake-Porn-Videos, die rechte Chats von berühmten Frauen wie Taylor Swift verbreiten. Die plakativen Botschaften, die durch die schlagworthaften Bilder von linken wie rechten Akteur*innen verbreitet werden, tragen dabei zu einer Verhärtung des gesamten Diskurses bei, die die Kulturwissenschaftlerin Annekathrin Kohout als Zynismus und lustvolle, enthemmte Unmoral beschreibt.17 Fotos von der US-Ministerin für Heimatschutz Kristi Noem vor einer Gefängniszelle in El Salvador, die Ghibli-fizierte Version der Festnahme einer Frau durch einen ICE-Mitarbeiter oder – in einem größeren Kontext betrachtet – auch die kürzlich erschienene Werbung mit Sydney Sweeney, die über ihre tollen Gene bzw. Jeans redet: All diese medialen Artefakte tragen dazu bei, dass sich das Overton-Fenster, also das, was sag- und denkbar ist, immer mehr in die Richtung einer grenzenlos scheinenden Dehumanisierung verschiebt. Denn bei diesen Videos und Bildern geht es nicht um einen reziproken Austausch, wie Kohout schreibt. Vielmehr seien die Bilder „kommunikationsverweigernd“ und „keine Einladung zum Gespräch, sondern lediglich zur Reaktion.“ Ähnlich drückt es, nach den AI-Slop-Bildern auf den Kanälen der US-Regierung gefragt, auch der Twitcher Hasan Piker aus: „[Everything] is about triggering the libs […]. That has not changed. That’s the underpinning of reactionary thought. It’s turned into: Oh, does this piss off whatever liberal blob, then that’s good. It’s cool.“18

Vom Schlagwort zum Hashtag

Natürlich sind Memes in Hinblick auf die Formulierungen politischer Ansprüche keineswegs unschuldig. Gerade die jüngsten Diskurse um die Ermordung des rechten Influencers Charlie Kirk und die Mutmaßungen um die Nähe des Attentäters zur sogenannten Groyper-Bewegung zeigen, dass auch memetische vernaculars vor allem aus dem rechten Spektrum zur weiteren gesellschaftlichen Spaltung und politischen Gewalt beitragen. Die postironische Haltung, mit der Memes geteilt und zitiert werden, birgt dabei immer das Potenzial, eine Kultur des Zynismus und Nihilismus zu verstärken. Allerdings liegt – vor dem Hintergrund der angesprochenen Kommunikationsverweigerung von AI-Slop – das größte demokratische Potenzial von Memes gerade in ihrer Instabilität. Memes sind durch ihren fragilen Remix-Charakter für Gegenrede offen. Oder, um es mit den Worten der Journalistin Kaitlyn Tiffany zu sagen: „The only universal rule of memes, after all, is that they know no master.“19

Obwohl sich dieser Text bisher vor allem mit den Unterschieden zwischen klassischen Internet-Memes und AI-Slop bzw. Slopaganda beschäftigt hat, soll zum Schluss der Versuch unternommen werden, beide Phänomene zusammenzubringen. Denn es ist sehr wahrscheinlich, dass beide Bildformen in der Zukunft fusionieren und dadurch immer weniger klar voneinander abzugrenzen sein werden. Online gibt es bereits immer mehr hybride Formen zwischen Memes und Slop, wenn etwa den Slop-Videos oder -Bildern eine humorvolle Caption hinzugefügt wird. Sprache scheint ohnehin das entscheidende Element zu sein, das AI-Slop für Meme-Praktiken anschlussfähig macht. Ein Beispiel dafür ist ein Slop-Trend, der sich 2024 auf der Plattform X etablierte, wie Roland Meyer in dem Podcast In Bed With The Right berichtet.20

Zunächst verbreiteten sich unter dem Hashtag #RememberEngland eine Reihe nostalgisch anmutender KI-Bilder, denen ein rechtes Narrativ zugrundeliegt: sie sollten ein sicheres Großbritannien zeigen, bevor es von Geflüchteten und Menschen nicht-britischer Herkunft bedroht wurde. Sowohl Hashtag als auch Ästhetik wurden anschließend in parodierender Weise aufgegriffen und zeigten in der Folge absurde Bilder einer Vergangenheit Englands, die wahlweise auf dem Mond angesiedelt war oder St. George neben Dinosauriern platzierte. Das memetische Verbindungsstück war hier der Hashtag, der die Slop-Bilder miteinander in Beziehung setzte. #RememberEngland wurde dabei zu einem sogenannten Snowclone, also einem sprachlichen Element „that can be used and reapplied“,21 wie es der Kunsthistoriker und Bildwissenschaftler Kyle Parry ausdrückt. In diesem Beispiel kommen Prompt-Idee und Snowclone zusammen und ermöglichen die humoristische Gegenrede auf der Meta-Ebene. Insofern ist es wahrscheinlich, dass Slop-Elemente in Zukunft häufiger Teil memetischer Remix-Kultur werden. Dabei wird vor allem spannend zu beobachten sein, wie die bildliche Verschlagwortung aufgehoben werden kann und neue, kreative Um- und Bedeutungen durch Slop-Memes entstehen.

- Limor Shifman: Wenn Meme digital werden [2014], in: Tilman Baumgärtel (Hg.): Texte zur Theorie des Internet, Ditzingen 2020, 270–284, hier 272ff. ↩︎

- KI Verstehen: Wie „AI Slop“ Kultur und Ästhetik verändert, Podcast, 5:19 Min., mit Carina Schroeder und Moritz Metz, Erstausstrahlung 7.8.2025, Deutschlandfunk, www.deutschlandfunk.de/ki-spam-ai-slop-kreativitaet-100.html (12.8.2025). ↩︎

- Huo Jingnan: AI-generated images have become a new form of propaganda this election season, in: NPR, 18.10.2024, www.npr.org/2024/10/18/nx-s1-5153741/ai-images-hurricanes-disasters-propaganda (12.8.2025). ↩︎

- Kyle Chayka: Resisting Trump 2.0 with Brain-Rot Memes, in: The New Yorker, 26.3.2025, www.newyorker.com/culture/infinite-scroll/resisting-trump-20-with-brain-rot-memes (12.8.2025). ↩︎

- Titus Blome: KI-Bilder fluten Facebook: Shrimp Jesus ist wahrhaftig auferstanden, in: Der Freitag, 2.4.2024, www.freitag.de/autoren/titus-blome/ki-bilder-fluten-facebook-shrimp-jesus-ist-wahrhaftig-auferstanden (12.8.2025). ↩︎

- Kyle Parry: A Theory of Assembly: From Museums to Memes, Minneapolis 2022, 167. ↩︎

- Hito Steyerl: In Defense of the Poor Image, In: e-flux Journal, Nr. 10, 2009, www.e-flux.com/journal/10/61362/in-defense-of-the-poor-image (12.8.2025). ↩︎

- Nick Douglas: It’s Supposed to Look Like Shit: The Internet Ugly Aesthetic, in: Journal of Visual Culture, Bd. 13, Nr. 3, 2014, 314–339, hier 315. ↩︎

- Robby Hardesty, Jess Linz & Anna J. Secor: Walter Benja-Memes, in: GeoHumanities, Bd. 5, Nr. 2, 2019, S. 496–513., hier 5. ↩︎

- Travis Diehl: Charlie Engman Transforms the Internet’s Murk into Art, in: aperture, 13.12.2024, https://aperture.org/editorial/charlie-engman-transforms-the-internets-murk-into-art/ (12.8.2025). ↩︎

- AI Forensics: AI Generated Algorithmic Virality, 31.7.2025, https://aiforensics.org/work/gen-ai-slop (13.9.2025). ↩︎

- Rosalind Krauss: Anmerkungen zum Index: Teil 1 [1976], in: Herta Wolf (Hg.): Paradigma Fotografie – Fotokritik am Ende des fotografischen Zeitalters, Frankfurt/M. 2023 [2002], 140–157, hier 143. ↩︎

- Roland Meyer: Echte Emotionen. Generative KI und rechte Weltbilder, in: Geschichte der Gegenwart, 2.2.2025, https://geschichtedergegenwart.ch/echte-emotionen-generative-ki-und-rechte-weltbilder/ (12.8.2025). ↩︎

- Roland Meyer im Interview mit Florian Keller: „KI-Bildgeneratoren sind Nostalgiemaschinen und Klischeeverstärker“, in: woz – Die Wochenzeitung, 15.5.2025, https://www.woz.ch/2520/roland-meyer/ki-bild-generatoren-sind-nostalgie-maschinen-und-klischee-verstaerker (12.8.2025). ↩︎

- Vgl. Jingnan: AI-generated images have become a new form of propaganda. ↩︎

- Katharina Stahlhofen: Digitalfaschismus in Pastell, in: die taz, 26.6.2025, https://taz.de/Echte-rechte-Bildaesthetiken/!6095310/ (12.8.2025). ↩︎

- Annekathrin Kohout: „Feed Interrupted“: Zynismus und lustvolle Unmoral, in: Sofrischsogut Blog, 8.4.2025, www.sofrischsogut.com/post/feed-interrupted-zynismus-und-lustvolle-unmoral (12.8.2025). ↩︎

- Doomscroll, Podcast, 19:57 Min., mit Joshua Citarella und Hasan Piker, veröffentlicht am 1.7.2025, Spotify, https://open.spotify.com/episode/4naN8o0mNjmohzoMhOHaUY?si=Os3KBLoESkqs4e_6ltm31A (12.8.2025). ↩︎

- Hardesty u.a.: Walter Benja-Memes, 3. ↩︎

- In Bed With The Right Episode 62: AI Slop and the New Fascist Aesthetic, Podcast, 9:14 Min., Roland Meyer im Interview mit Adrian Daub und Moira Donegan, veröffentlicht am 11.3.2025, Spotify, https://open.spotify.com/episode/5XxfdDFetoiYRWqkAdtW3w?si=UQ53krdOT6qimOU30Q7THw (12.8.2025). ↩︎

- Parry: A Theory of Assembly, 143. ↩︎

Veröffentlicht am 08.10.2025